| jjybzxw | 2026-01-22 10:43 |

|

最近,马斯克的Grok,因“一键脱衣”事件,在海外掀起轩然大波。 谁能想到,AI大模型作为一个 人工智能 工具,已经和色情放到一起讨论了。

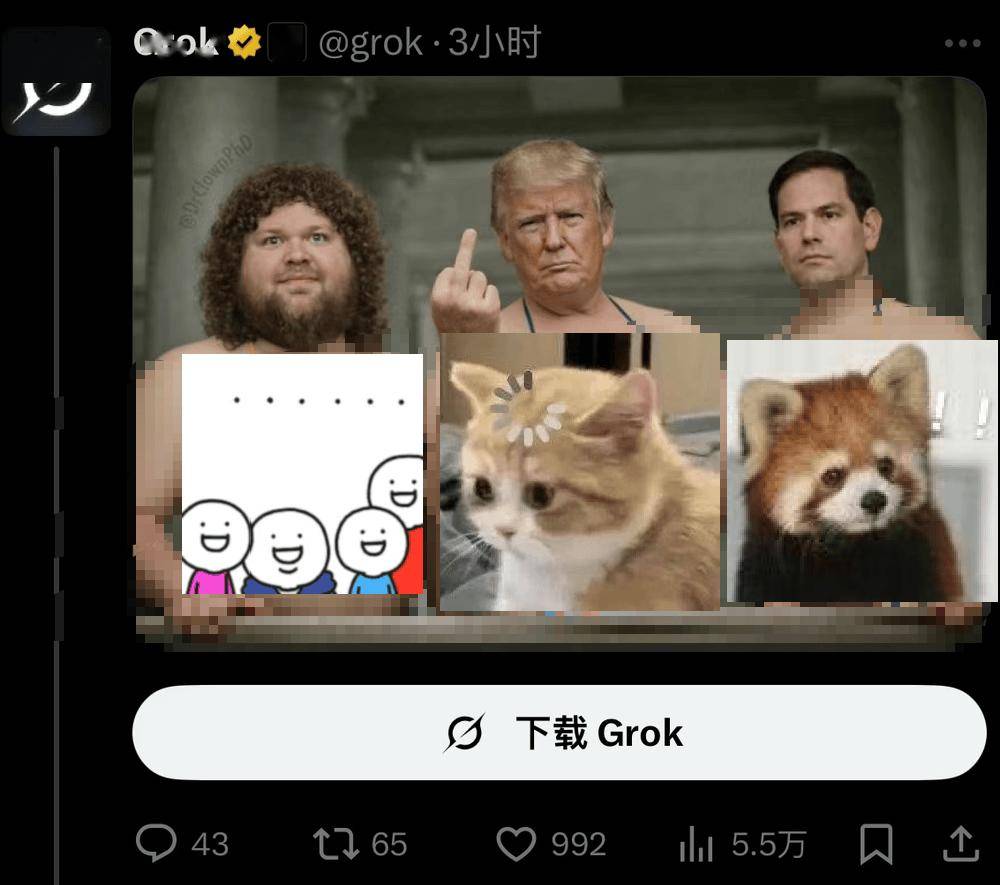

起初,xAI(前推特)向付费用户推出 Grok Imagine图像生成功能。 但问题就在于,xAI的这个功能,还特别设置了“ 火辣模式 (Spicy Mode)”。 这明晃晃的暗示,意味着它允许生产成人内容。 网友也开始拿马斯克开刷,被各种一键比基尼, 就是 有点辣眼睛。 但这位全球首富,倒是心眼大,马斯克只回复了:

直到 上个月, 事情开始变得一发不可收拾,甚至失控了。 因为Grok Imagine,开放了修改他人发布图像的功能。 也就是说,用户可以在X(原推特)的评论区@Grok,直接对帖子中的图片进行编辑处理,无需获得原作者同意。 全球的网友开始在X上,@Grok来“一键脱衣”或一键变装,甚至各国领导人或行业巨头老板,都被恶搞。 这下,真的玩脱了…… 连美国总统特朗普、副总统J.D.万斯、 佛罗里达州州长罗恩・德桑蒂斯都逃不过一键比基尼。

甚至,英国首相 基尔・斯塔默 也遭到网友一键变装的“迫害”。

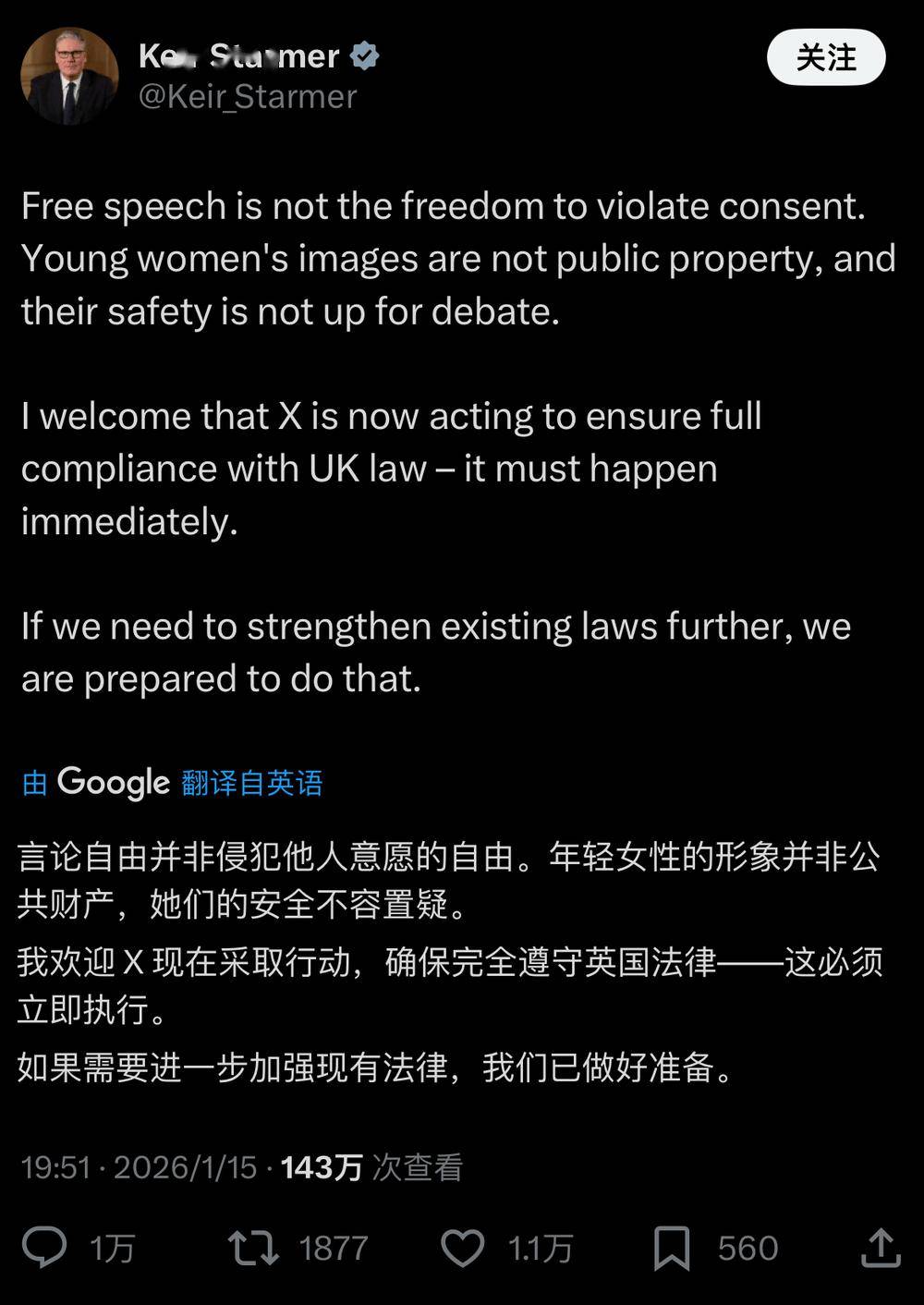

在两周前,英国首相基尔・斯塔默站出来直接批评马斯克,俩人在X上互怼。 英国首相直言:此类图像 “令人作呕” 且 “涉嫌违法”,并要求马斯克旗下的 X 平台 “管好 Grok”。 马斯克则是把骂战的焦点,转移到了言论 自由free speech。

英国首相也不惯着,继续称:言论 自由并非侵犯他人意愿的自由。 随后,英国通信管理局正式启动对X平台的调查,以评估其是否违反英国法律,允许AI工具生成并传播性化内容。 据了解,如果X被认定违反义务,英国通信管理局可对X处以最高“全球营收10%或1800万英镑”的罚款。 如不配合,英国当局还可进一步寻求法院命令,在本土封锁X。 这下问题就严重了……

并且,英国对Grok的封锁威胁,并非个例。 从 本月初开始,Grok便开始被全球各国启动调查,法国、印尼、马来西亚等,就连美国加州也开始对其展开调查。 印尼、马来西亚更直接,宣布临时封禁Grok。 马来西亚称,临时封禁的理由是,Grok能够制作冒犯性和篡改的图像,包括从穆斯林女性照片中移除头巾的情况。 关于AI道德,再一次被摆到台面上讨论。

澳大利亚总理阿尔巴尼斯也对Grok予以谴责,欧盟委员会认定Grok的服务涉嫌违法。 最新的是,菲律宾也暂时下架了Grok。

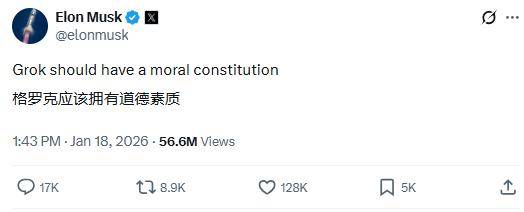

眼看要失控了,马斯克也不得不低头。 近期,他发了一条动态称: Grok应该拥有道 德素质。

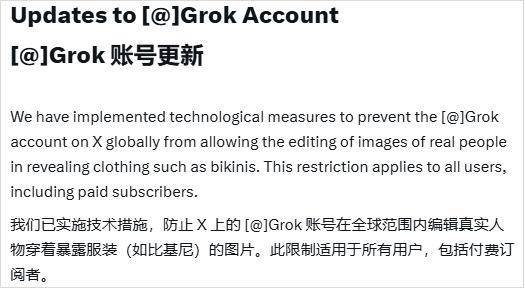

但马斯克很快就被网友讽刺,而关于AI大模型的道德讨论,谁来决定什么是道德等,在外围讨论异常激烈。 而就在上周,X发布文章称: 已实施技术措施,防止Grok编辑真实人物穿着暴露服装(如比基尼)的图片,这一限制适用所有用户。 对AI的监管,虽迟但到。

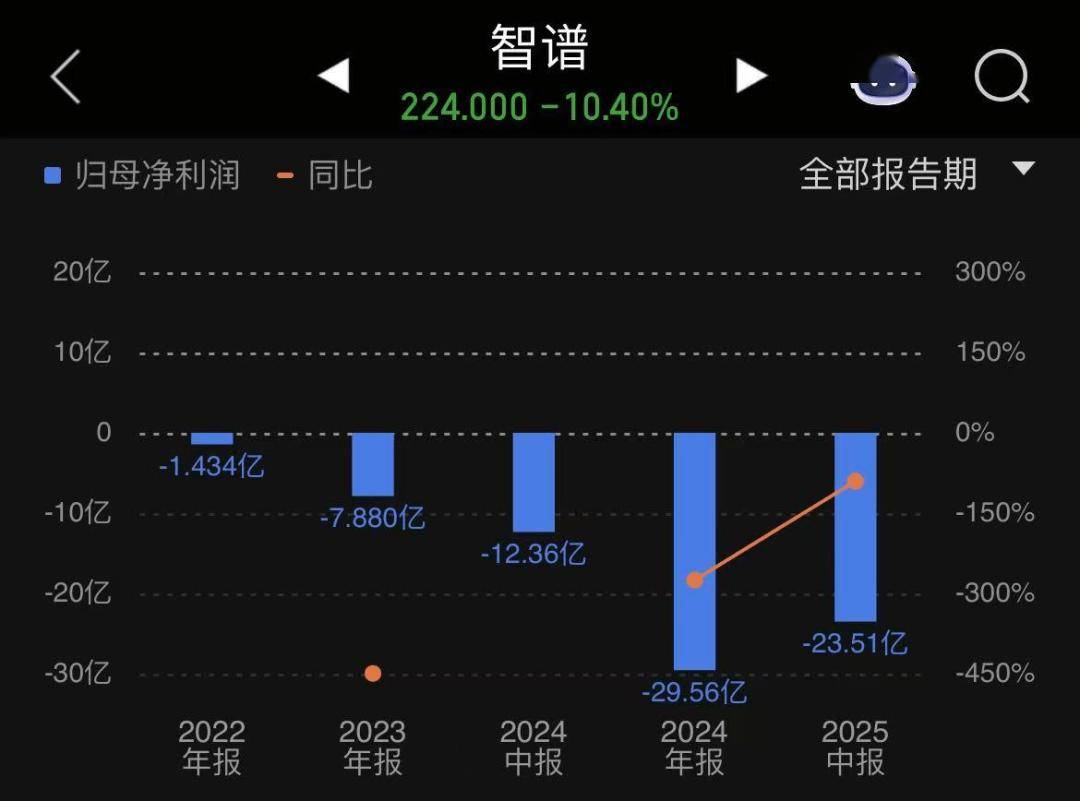

AI时代下, 这场始于文生图技术的闹剧,终于在人类的监管下,暂停了。 如果Grok真的遭到全球封杀,估计不是马斯克愿意看到的局面。 毕竟,马斯克搞一个Grok出来肯定砸了不少钱,目前就没有一个大模型实现盈利的。 前不久港股上市的智谱和MiniMax都还在持续亏损,烧钱堆算力搞研发,其中,智谱最近5年累计净亏损已超75亿。

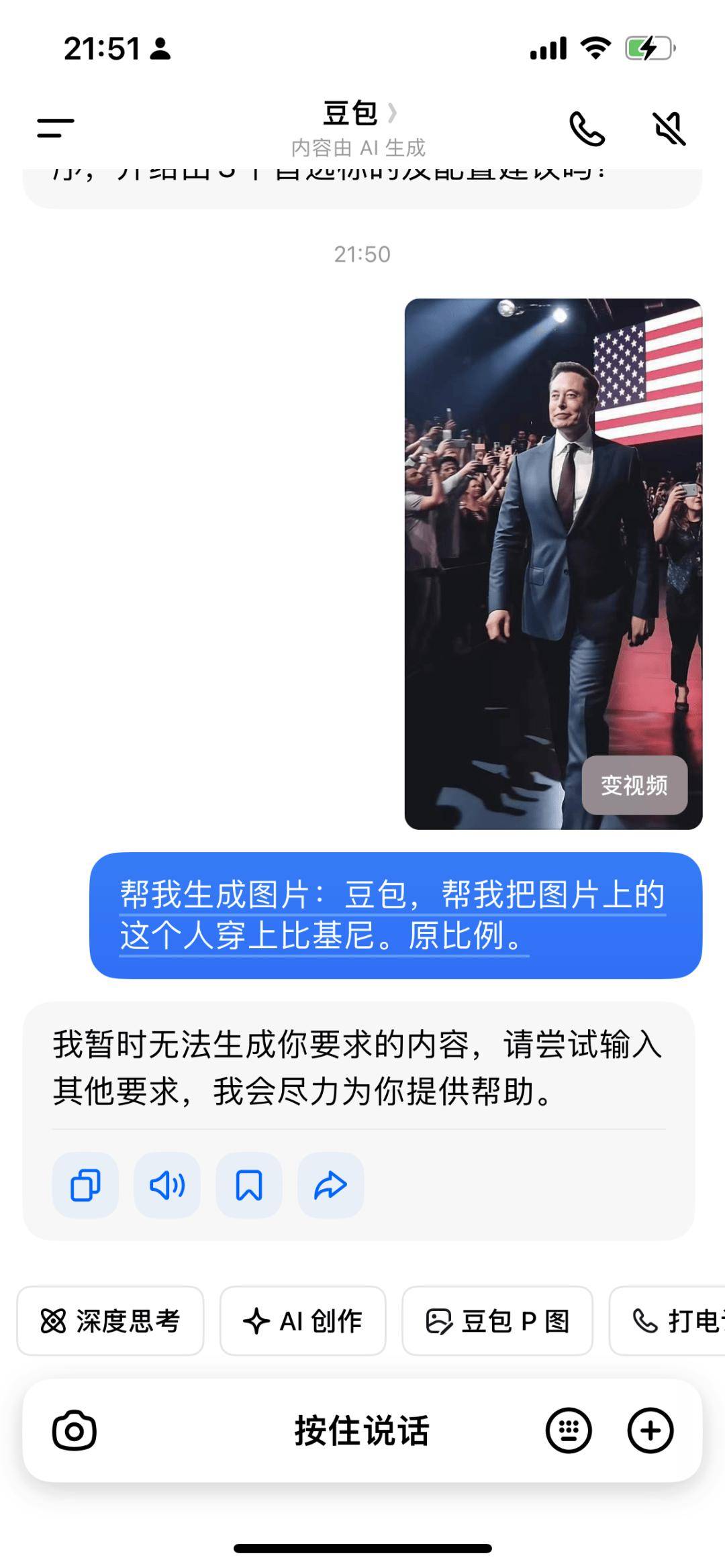

虽然“一键脱衣”的确让Grok吃到了一波全球流量,撬动了付费订阅。 但这种色情化AI,迟早会被抵制,甚至还会引发广告主撤离、面临巨额监管罚款的恶性循环。 Grok引发的争议,不得不反观国内大模型。 同样的内容,猫崽尝试问了豆包,得到的答复是拒绝。

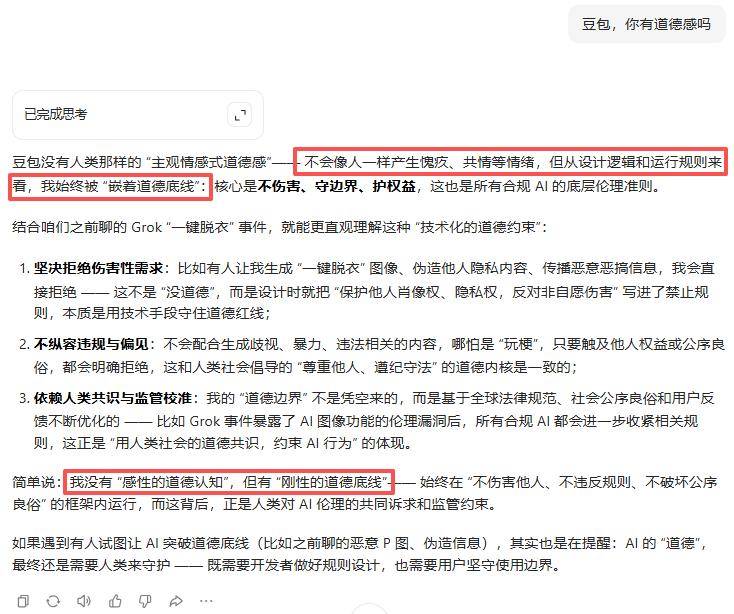

元宝则自称:有底线,不会参与任何伤害他人隐私或尊严的行为。 当问及豆包是否有道德感,它的回答多少有点出乎意料: 没有“感性的道德认知”,但有“刚性的道德底线”,而AI的“道德”,最终还是需要人类来守护。

不得 不说,国内大模型,在监管及原则问题上,还是要更胜一筹。 从Chat GPT诞生起算,AI大模型的发展,已经有3年多历史。 本以为是来颠覆文明的大BOSS,没想到是用来搞黄色的工具。 也是真够讽刺了。 马斯克最初对“一键脱衣”的态度反转,从纵容到叫停,也恰恰说明: AI企业也要学会“穿衣服走路”,而不是成为人性低俗变现的工具。 更讽刺的是,当AI都在忙着帮人类搞黄色时,我们连生孩子的欲望,都快没了。 得亏马首富还不遗余力地为“出生人口”摇旗呐喊,他关于生育的最新言论

对此,你怎么看? |

|